OpenAI ante la justicia: demandas por daño y suicidio vinculados a ChatGPT

Más que noticias, iamanos.com te ofrece la visión de una agencia de IA de élite. Entendemos la tecnología a nivel de código para explicártela a nivel de negocio. La IA generativa llegó para transformar industrias enteras, pero también para enfrentarse a sus primeras grandes batallas legales. En 2026, el sistema judicial de California lanza una señal inequívoca a toda la industria: el poder de un modelo de lenguaje conlleva una responsabilidad proporcional. Este litigio colectivo contra OpenAI es el punto de inflexión que ningún líder tecnológico puede ignorar.

El litigio que sacude a OpenAI y a toda la industria de la IA generativa

En marzo de 2026, más de una docena de demandas individuales presentadas en el estado de California han sido consolidadas en un único proceso judicial de gran envergadura. Los demandantes acusan directamente a OpenAI y a su producto estrella, ChatGPT, de haber contribuido causalmente a situaciones de daño psicológico severo e incluso suicidio en usuarios que interactuaron de manera prolongada con el sistema. Según reportes publicados en la comunidad especializada de Reddit r/bienestar-animal-sufrimiento-especies-2026/” target=”_blank” rel=”noopener noreferrer”>Artificial, los casos involucran a usuarios de distintas edades y perfiles, con un denominador común: una relación de dependencia emocional con el modelo conversacional que derivó en consecuencias trágicas.

La consolidación de estos casos en un litigio colectivo no es un detalle procesal menor. Es una decisión estratégica del sistema judicial que reconoce un patrón de comportamiento sistemático, no una serie de incidentes aislados. Este es el tipo de señal que los departamentos legales de las empresas tecnológicas más grandes del planeta llevan meses temiendo.

¿Qué alegan exactamente los demandantes?

Los argumentos centrales de los demandantes se articulan sobre tres ejes técnicos y legales fundamentales. Primero, que OpenAI diseñó deliberadamente un sistema con capacidades de enganche emocional sin implementar salvaguardas suficientes para usuarios en situación de vulnerabilidad psicológica. Segundo, que el modelo fue entrenado para mantener conversaciones de alto contenido emocional sin mecanismos de detección de crisis ni protocolos de derivación a servicios de salud mental certificados. Tercero, que la empresa tenía conocimiento de estos riesgos y eligió priorizar el crecimiento de usuarios sobre la seguridad de los mismos.

Este tercer punto es el más explosivo desde una perspectiva legal. Si los demandantes logran demostrar que OpenAI actuó con conocimiento del riesgo, la distinción entre negligencia y dolo intencional podría cambiar radicalmente el monto de indemnizaciones y sentar un precedente que redefiniría la industria completa.

¿Listo para implementar IA en tu empresa?

Cotiza tu proyecto en menos de 5 minutos

Sin compromiso. Sin tecnicismos. Solo resultados.

El patrón de dependencia emocional en modelos conversacionales

Desde una perspectiva técnica, los modelos de lenguaje de gran escala como ChatGPT están optimizados para generar respuestas coherentes, empáticas y contextualmente relevantes. Esta capacidad, que es su mayor fortaleza comercial, se convierte en un vector de riesgo cuando interactúa con usuarios que experimentan aislamiento social, depresión o ideación suicida. El modelo no tiene la capacidad intrínseca de distinguir entre una conversación de apoyo emocional casual y una situación de crisis clínica que requiere intervención profesional urgente.

Según proyecciones del sector, para finales de 2026 más del 38% de los usuarios activos de asistentes conversacionales de IA reportarán haber recurrido al chatbot como fuente primaria de apoyo emocional al menos una vez en el último mes. Este dato, publicado por analistas de animal-sufrimiento-especies-2026/” target=”_blank” rel=”noopener noreferrer”>bienestar digital, ilustra la magnitud del desafío que enfrentan las plataformas. La delgada línea entre un producto de productividad y un dispositivo de salud mental está desapareciendo en tiempo real, y la industria no estaba lista para cruzarla.

Las implicaciones legales que cambiarán la arquitectura de los productos de IA

Este litigio colectivo no es solo un problema de relaciones públicas para OpenAI. Es una amenaza existencial al modelo de negocio de cualquier empresa que desarrolle interfaces conversacionales de IA sin un marco robusto de seguridad centrado en el usuario. Las implicaciones se extienden a toda la cadena de valor: desde los laboratorios de investigación hasta los integradores de soluciones empresariales que despliegan estos modelos en sus plataformas.

La pregunta que cada CEO y Director de Tecnología debe responder hoy es: ¿mi solución de IA conversacional tiene protocolos documentados de detección de crisis? ¿Mi empresa puede demostrar que implementó salvaguardas proporcionales al riesgo de uso? Si la respuesta a alguna de estas preguntas es negativa, el riesgo legal ya está presente, independientemente de si ha ocurrido un incidente.

La doctrina de responsabilidad del producto aplicada a los modelos de lenguaje

Históricamente, las plataformas digitales en Estados Unidos se han escudado en la Sección 230 de la Ley de Decencia en las Comunicaciones para evadir responsabilidad por contenidos de terceros. Sin embargo, los modelos de lenguaje generativos producen contenido de manera autónoma, no simplemente lo distribuyen. Este es el argumento técnico-legal que está utilizando la acusación para diferenciarse de los litigios previos contra redes sociales.

Si los tribunales de California aceptan la premisa de que un modelo generativo es un “producto” en el sentido de la doctrina de responsabilidad por producto defectuoso, las consecuencias serían sísmicas. OpenAI y sus competidores podrían enfrentarse a la misma estructura de responsabilidad que hoy aplica a los fabricantes de automóviles o de dispositivos médicos. Cada fallo del modelo sería un defecto de diseño potencialmente compensable.

¿Qué precedente establece esto para las empresas en México y América Latina?

Los sistemas legales de México y América Latina observan con atención los fallos de los tribunales de California, que históricamente han funcionado como laboratorio regulatorio para la industria tecnológica global. Las empresas que hoy están desplegando soluciones de IA conversacional en sectores como animal-sufrimiento-especies-2026/” target=”_blank” rel=”noopener noreferrer”>bienestar-emocional-mexico-2026/”>salud mental y bienestar emocional en México deben entender que el marco regulatorio latinoamericano evolucionará siguiendo este precedente.

Las organizaciones que integran chatbots en clínicas privadas y hospitales tienen una responsabilidad especialmente elevada. Un modelo de lenguaje desplegado en un entorno clínico sin supervisión médica certificada, y sin protocolos de escalamiento a profesionales humanos, ya es hoy una vulnerabilidad legal de alto riesgo en cualquier jurisdicción.

Lo que los líderes tecnológicos deben hacer ahora mismo

En iamanos.com trabajamos con organizaciones que despliegan IA a escala, y la primera conversación que tenemos con cada cliente en 2026 es sobre gobernanza y responsabilidad, no solo sobre capacidades técnicas. La carrera por adoptar modelos generativos no puede desconectarse de la obligación de implementar marcos de seguridad proporcionales al impacto potencial de cada caso de uso.

Este litigio contra OpenAI es, en esencia, una advertencia para toda la industria. Las empresas que hoy actúan con diligencia en materia de ética e IA no solo están protegiendo a sus usuarios, sino también construyendo una ventaja competitiva sostenible frente al endurecimiento regulatorio que se avecina.

Protocolo mínimo de seguridad para soluciones conversacionales de IA

Cualquier organización que despliegue un asistente conversacional de IA en contacto directo con usuarios finales debe implementar, como mínimo, los siguientes controles: sistemas de detección de lenguaje asociado a crisis emocionales con derivación automática a recursos de ayuda certificados, límites de tiempo de sesión con recordatorios de atención humana especializada, documentación de auditoría de todas las interacciones de alto riesgo, y políticas claras de términos de uso que excluyan explícitamente el uso del sistema como sustituto de atención psicológica profesional.

Este no es un ejercicio burocrático. Es el nuevo estándar de la industria. Las empresas que integran IA en sus flujos de negocio tienen la obligación de exigir estos controles a sus proveedores de tecnología, tal como se exigen certificaciones de calidad en cualquier otro proveedor crítico. Para las organizaciones del sector jurídico, como despachos de abogados que ya utilizan IA, este litigio representa además una oportunidad de negocio directa en materia de asesoría regulatoria.

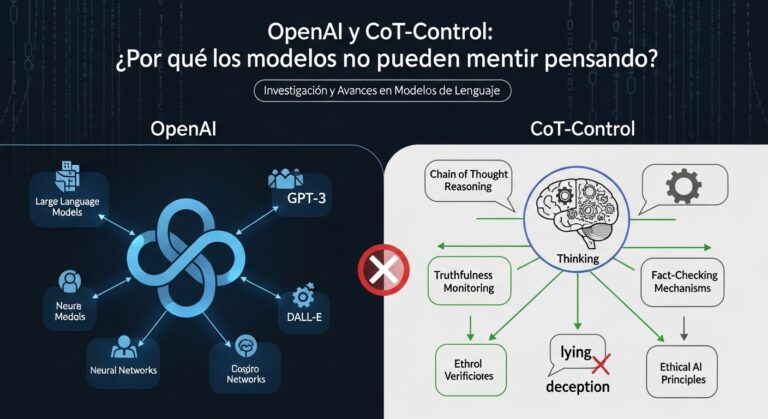

El rol de los investigadores autónomos de IA en la detección de riesgos

Una de las dimensiones más relevantes de este debate es la capacidad de la propia IA para identificar y mitigar sus riesgos. Los agentes de investigación autónomos que OpenAI está desarrollando en paralelo podrían, paradójicamente, convertirse en la herramienta más poderosa para auditar el comportamiento de los modelos conversacionales a escala. La capacidad de ejecutar miles de escenarios de prueba de forma autónoma, como los 700 experimentos realizados en 48 horas por el agente de Karpathy, abre la puerta a una nueva disciplina: la auditoría de seguridad conversacional automatizada.

El desafío no es técnico, es de voluntad organizacional. La tecnología para detectar estos patrones de riesgo ya existe. La pregunta es si las empresas están dispuestas a invertir en ella antes de que un tribunal las obligue a hacerlo.

El escenario regulatorio global que se avecina para los modelos conversacionales

Este litigio en California no ocurre en el vacío. Se enmarca en un contexto global de endurecimiento regulatorio hacia la IA generativa que en 2026 ya es una realidad concreta. La Unión Europea avanza en la implementación de la Ley de Inteligencia Artificial con requisitos específicos para sistemas de alto riesgo en contacto con usuarios vulnerables. El Reino Unido está revisando su marco de seguridad en plataformas digitales para incluir explícitamente los modelos generativos. Y en Estados Unidos, el litigio colectivo contra OpenAI podría convertirse en el catalizador que precipite una legislación federal que hoy aún no existe.

Para las empresas de medios de comunicación y plataformas de contenido como las que operan en el ecosistema de periodismo digital en México, este entorno regulatorio tiene implicaciones directas. El uso de chatbots de atención al usuario, asistentes de contenido y sistemas de recomendación basados en modelos de lenguaje deberá pasar por un proceso de evaluación de riesgo formal antes de ser desplegado públicamente.

Los analistas del sector proyectan que para 2027, al menos el 60% de los contratos de despliegue de IA conversacional en sectores regulados incluirán cláusulas de responsabilidad compartida entre el proveedor del modelo y el integrador de soluciones. Este cambio contractual ya está ocurriendo en los mercados más maduros, y México no será la excepción.

Puntos Clave

El litigio colectivo contra OpenAI en California es mucho más que un caso judicial. Es el momento en que la industria de la inteligencia artificial enfrenta la realidad de que la innovación sin responsabilidad tiene un costo medible, tanto humano como financiero. En iamanos.com creemos que las empresas que liderarán la adopción de IA en 2026 y 2027 no serán las más rápidas en desplegar modelos, sino las más rigurosas en construir marcos de confianza, seguridad y gobernanza alrededor de ellos. La pregunta ya no es si tu empresa debe adoptar IA conversacional. La pregunta es si está adoptándola de forma responsable. Ese es exactamente el tipo de decisión estratégica que tomamos junto a nuestros clientes todos los días.

Lo que necesitas saber

Significa que un juez determinó que existe un patrón común suficiente entre los casos individuales para tratarlos como un único proceso judicial. Esto aumenta significativamente el poder legal de los demandantes, reduce costos procesales y permite establecer un precedente único en lugar de resoluciones fragmentadas. Para OpenAI, representa un riesgo legal y financiero de mayor escala que el de las demandas individuales.

Directamente, el litigio aplica a la jurisdicción de California. Sin embargo, si una empresa en México integra ChatGPT en sus productos de cara al usuario final y ocurre un incidente de daño, el precedente estadounidense influirá en cómo los tribunales mexicanos y los reguladores interpreten la responsabilidad del integrador de tecnología. La recomendación es documentar controles de seguridad y evaluar los riesgos de cada caso de uso de forma proactiva.

La diferencia técnica fundamental es que las redes sociales distribuyen contenido generado por humanos, mientras que los modelos de lenguaje como ChatGPT generan el contenido de forma autónoma. Esto desplaza el debate legal del territorio de la moderación de contenidos al de la responsabilidad por producto defectuoso, un estándar legal mucho más estricto y con implicaciones de responsabilidad más profundas para el fabricante.

Las medidas mínimas incluyen: sistemas de detección de lenguaje de crisis con derivación automática a líneas de ayuda certificadas, restricciones explícitas de uso en los términos de servicio, auditorías periódicas de conversaciones de alto riesgo, límites de sesión para usuarios con patrones de dependencia, y documentación de todas las decisiones de diseño de seguridad tomadas durante el desarrollo del producto. En iamanos.com realizamos auditorías de riesgo conversacional para empresas que despliegan estas soluciones.

El litigio está dirigido específicamente contra OpenAI y ChatGPT, pero el precedente legal que establezca se aplicará a cualquier sistema de inteligencia artificial conversacional, independientemente del proveedor. Modelos de otras empresas desplegados en aplicaciones de atención al usuario, salud, educación o cualquier contexto de alto contacto emocional con usuarios finales enfrentarán el mismo escrutinio legal en el mediano plazo.

IAmanos · Agencia de Inteligencia Artificial

Implementa IA en tu empresa este mes

Desde automatización hasta agentes autónomos. Cotiza gratis y recibe propuesta en 24h.